传统的聊天机器人,无论是Eliza还是Alice,它们的原理都是基于一个叫做模式匹配(pattern matching)的技术。

当它听到一个关键词时,它会调取一个已经预设好的应答,就像当你跟它说“你好”时,它会问你“人说吃了吗?”;

或者当它听到“妈妈”时,它会要求你跟它谈谈你的家庭。实际上,现在一些购物网站和银行等领域的机器人也是基于这种模式匹配的原理。

比如,当你跟这些机器人聊天时,一旦提到退货,它们就会发送给你退货流程;或者当你提到ATM时,它们就会发送给你附近ATM的地图。

虽然这种匹配模式并不算非常智能,但它确实能够减少大量重复的机械性回答,从智能角度来说,这种限定规则的机器人即使规则写得

再复杂、预设再多,也不可能穷尽所有的答案,更不可能创造新的答案。所以,想要通过图灵测试,成为真正的智能,

仅仅依靠这种模式匹配是不可能实现的。

因此,出现了语言学习中一个新的流派,也是人工智能中非常重要的一部分,那就是机器学习。顾名思义,

机器学习的基本理念是让机器去学习,不给它人为规定的一些规则和回答,而是提供大量现成的例子,

让它自己去学习、找规律。这种方式听起来更加厉害,也更符合我们对学习的认知逻辑。

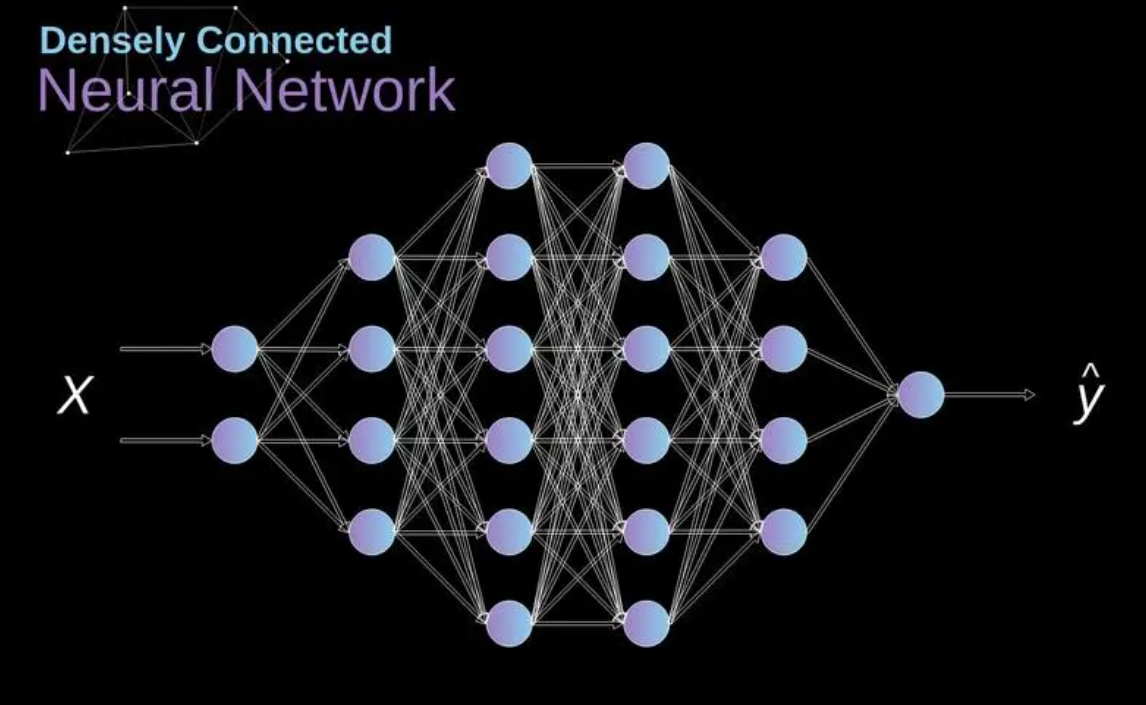

到了2010年,机器学习中的一个领域开始闪光,它叫做人工神经网络(Artificial Neural Network)。

人的大脑靠超过100亿个神经元通过网状链接来传递信息。尽管每个神经元都很简单,但它们组合起来可以判断非常复杂的信息。

因此,人工神经网络的目标就是模拟人脑的这种形式。输入信息后,它会经过若干个隐藏神经节点的判断,然后给出输出结果。

虽然人工神经网络的思想早在1960年代就有了,但它需要大量的数据和强大的算力来支撑。直到2010年代,随着互联网的发展,

数据变得越来越丰富,算力也不断提升。人们才发现,这种模式非常适合解决那些人类凭直觉就能判断的事情,比如识别人脸、

声音识别、自动驾驶等。所以,在文字领域的发展方面,人工神经网络并不太顺利。因为机器学习通常使用一种叫做循环神经网络(RNN)

来处理文字,它的处理方式是按顺序一个词一个词地学习,没有办法同时进行大量的学习,而且句子也不能太长,

否则前面学到的内容可能会被遗忘。

直到2017年,谷歌提出了一个新的学习框架,叫做Transformer。具体的机制比较复杂,我无法完全理解,但结果就是,

以前需要一个个学习的字现在可以同时学习了,就像电路中的并联一样。这样一来,训练的速度和效率就大大提高了。有了Transformer,

机器在文字学习方面就像打通了任督二脉,很多自然语言处理模型都是建立在它的基础上的。谷歌的BERT和GPT-3都是指这个Transformer。

现在技术方面已经非常强大,一切都准备就绪,只缺人和资金了。

2015年,马斯克、彼得·蒂尔等几位大佬一起注资10亿美元成立了一家非营利组织,叫做Open,即GPT的母公司,

致力于人工智能的研究。他们宣称不为赚钱而是为推动技术发展而成立这个组织,所以他们的研究成果和专利都是对外公开的。

投资人中有我们非常熟悉的马斯克,实际上,他逐渐发现特斯拉在人工智能方面也需要大量的研究投入,比如自动驾驶等。

为避免特斯拉与两家公司的利益冲突,他在2018年退出了OpenAI的董事会,所以现在OpenAI与马斯克已经关系不大了。

OpenAI这些大牛们也确实很厉害。2017年,谷歌推出了Transformer模型,OpenAI立即在此基础上进行研究学习。

2018年,他们发表了一篇论文,介绍了一个新的语言学习模型,称为GPT(Generate Pre-Train Transformer)。

之前的语言学习模型大多需要人工监督或给定标签,但GPT基本上不需要这些了。只需将大量数据输入其中,它就能自主学习。

OpenAI于2018年6月推出了第一代GPT,然后在2019年11月增加了训练数据量,推出了GPT-2。

机器学习主要依赖于模型和参数量。模型决定了机器如何学习,通过相同的数据,GPT可以比其他模型更快、更好地学习。

而参数量需要大量的计算资源支持,因此需要投入大量资金用于训练和验证。OpenAI团队对这个模型非常有信心,

所以下一步的挑战就是缺乏资金支持。每一次进步都可能需要增加数量级的数据来支撑,这些都需要实际资金的支持。

微软对OpenAI提供了超级计算能力的支持,准备大力推动发展。GPT-1一代只有1.2亿个参数,到了GPT-2则增加到了15亿个参数。

半年后推出的GPT-3直接提升了100倍,达到了1750亿个参数,效果非常好。已经开始展现出真正意义上

的GPT(Generate Pre-Train Transformer)特征,不管你问它什么,它都能给出回答。这在业内引起了轰动,

但这个纯机器训练出来的GPT-3有个问题,有时候回答得很好,有时候就差一点意思,而且无论增加多大的参数量,改善都非常有限。

为了解决这个问题,OpenAI加入了人工反馈的强化学习方法,在训练效率和效果方面都取得了显著进展。

2022年3月推出了GPT-3.5,并对对话进行了优化。2022年11月推出了,它是一个非常简单粗糙的聊天界面,

但你问它什么,它都能给你回答,感觉说得很有道理。当然,其中可能会有一些问题,这个我们以后再讨论。

总之,它确实可以聊天,而且在语言表达上也十分自然。经历了半个世纪的发展,ChatGPT肯定可以轻松通过图灵测试。

有人可能会怀疑OpenAI是个骗子公司,每天雇佣成千上万的人来回复你(开个玩笑)。

但我认为这种可能性不大,GPT确实已经颠覆了许多人对聊天机器人的认知,包括我在内。因此,在短短两个月内,

GPT的活跃用户数量突破了一亿,扩张速度可谓史上最快。